Сожгите свою аналитику

Все отчеты лгут

Я ежедневно читаю статьи по продвижению в интернете, маркетинговым акциям, A/B-тестированию и другим подобным штукам. И регулярно натыкаюсь на полное непонимание авторами влияния на их результаты небольшой, но очень важной детали под названием «дисперсия». Между тем, она может полностью разрушить всю логику исследования и даже выдать результаты прямо противоположные тому, что случилось на самом деле.

Для того, чтобы всерьез поговорить о дисперсии, придется дать ей определение. Это будет единственный сложный абзац в статье, обещаю.

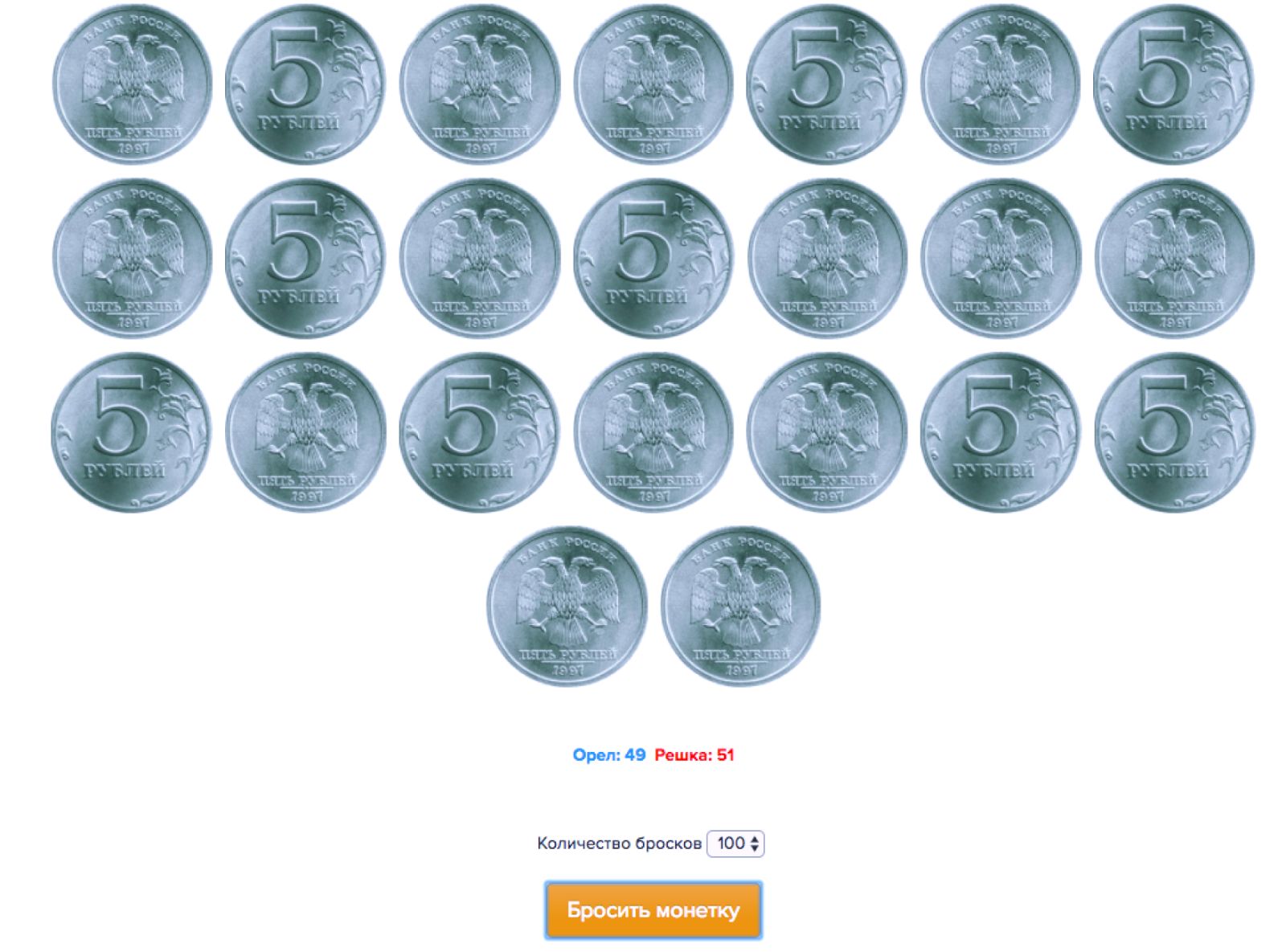

Дисперсия – это мера разброса случайной величины вокруг математического ожидания. Когда мы подбрасываем монетку, то знаем, что получим «орел» или «решку» в каждом отдельном испытании с вероятностью в 50%. С другой стороны, каждый понимает, что при серии в 100 подбрасываний мы вряд ли получим 50 раз «орел» и 50 раз «решку». Результат каждый раз будет находиться где-то около ожидаемого значения, но будет отличаться. Величина этого разброса и определяется дисперсией.

В онлайн-сервисе castlots.org мы «подбросили» пять рублей сто раз. Результат: 54/46 в пользу «орла».

Все гипотезы лгут

То, что интуитивно понятно с монеткой, почему-то перестает восприниматься, когда речь идет о других процессах, где случайность также присутствует.

Давайте я опишу сейчас типичную и, наверное, самую частую ошибку такого типа, а потом попробуем применить её к вашей деятельности.

Представьте предпринимателя Ивана, который дает рекламу в гугле с целью привлечь покупателей в интернет-магазин. Он настроил объявление, проплатил его. Кампания работает. Один клик на объявление стоит Ивану в среднем от 1 до 2 долларов, а прибыль от каждой продажи составляет 150 долларов.

Мы были очень голодны, когда заливали эту колонку на Spark.ru

10 показов. 30. 100. Продаж пока нет. 300 показов. 500 показов. К этому моменту две продажи. Иван потратил 750 долларов.

Реклама вырубается в гневе как неэффективная. Вся история начинается сначала. Запускается другое объявление...

500 показов. Пять броней. Делается вывод - хм, эта кампания в два с половиной раза эффективнее предыдущей. Зальем туда денег побольше.

100 показов, 500. 1000 показов. 4 брони. Результат внезапно упал, до результата прошлой кампании. Черт, оно перестало работать.

Где логическая ошибка Ивана? Иван принял решение об эффективности рекламы на основе слишком малой выборки. И дисперсия, которая безусловно присутствует в этом процессе, обманула его.

Вот пример не "потенциального Ивана", а из нашего бизнеса. Наши партнеры в США дают рекламу своих квестов на гугле. Цена клика для них получается около 30 центов, а средняя продажа приносит 25 долларов. Конверсия сайта из посетителя в покупателя составляет около 3%, т.е. каждый гость сайта с вероятностью в 3% становится покупателем. Мы покупаем трафик в 100 человек и ведем их на сайт.

Реклама как бы намекает о нашей международной экспансии

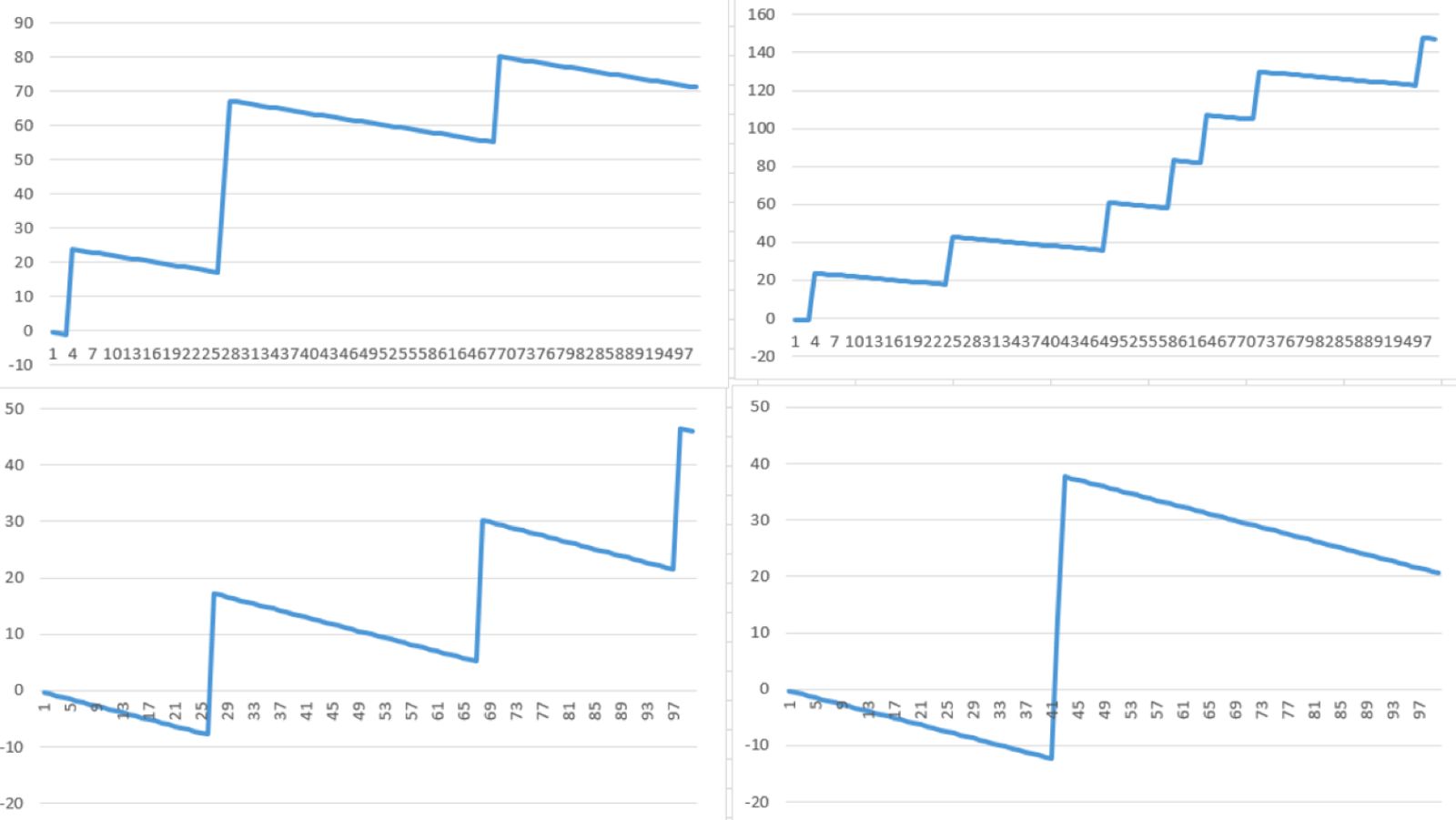

Как может выглядеть график такого процесса? Как будут выглядеть наши конкретные прибыли (или убытки)? Я не стал откладывать все это в долгий ящик и с помощью экселя визуализировал результаты такого эксперимента.

Я провел четыре эксперимента и вот такие у меня получились графики:

Разброс результатов в случайных процессах может превышать десятки раз

Еще раз обращаю ваше внимание - это один и тот же процесс. Все параметры у него одинаковые.

Но разброс случайной величины превращает наш итоговый результат то в 150 долларов (верхний правый график), то в 20 долларов. Разница больше чем в семь (!) раз.

В чем беда? Что не так? Проблема в системе? Может быть, 3% конверсии – это мало? Сразу предупрежу – теоретически тут все нормально. Построенная нами система имеет положительное матожидание (не буду объяснять, что это такое и почему так, просто примите на веру).

Проблема в том, что мы использовали слишком маленькую выборку.

На сто испытаний влияние дисперсии столь велико, что мы можем получить катастрофически разные результаты.

Мы снова зашли на симулятор и подбросили пять рублей еще сто раз. Результат: 49/51 в пользу... "решки".

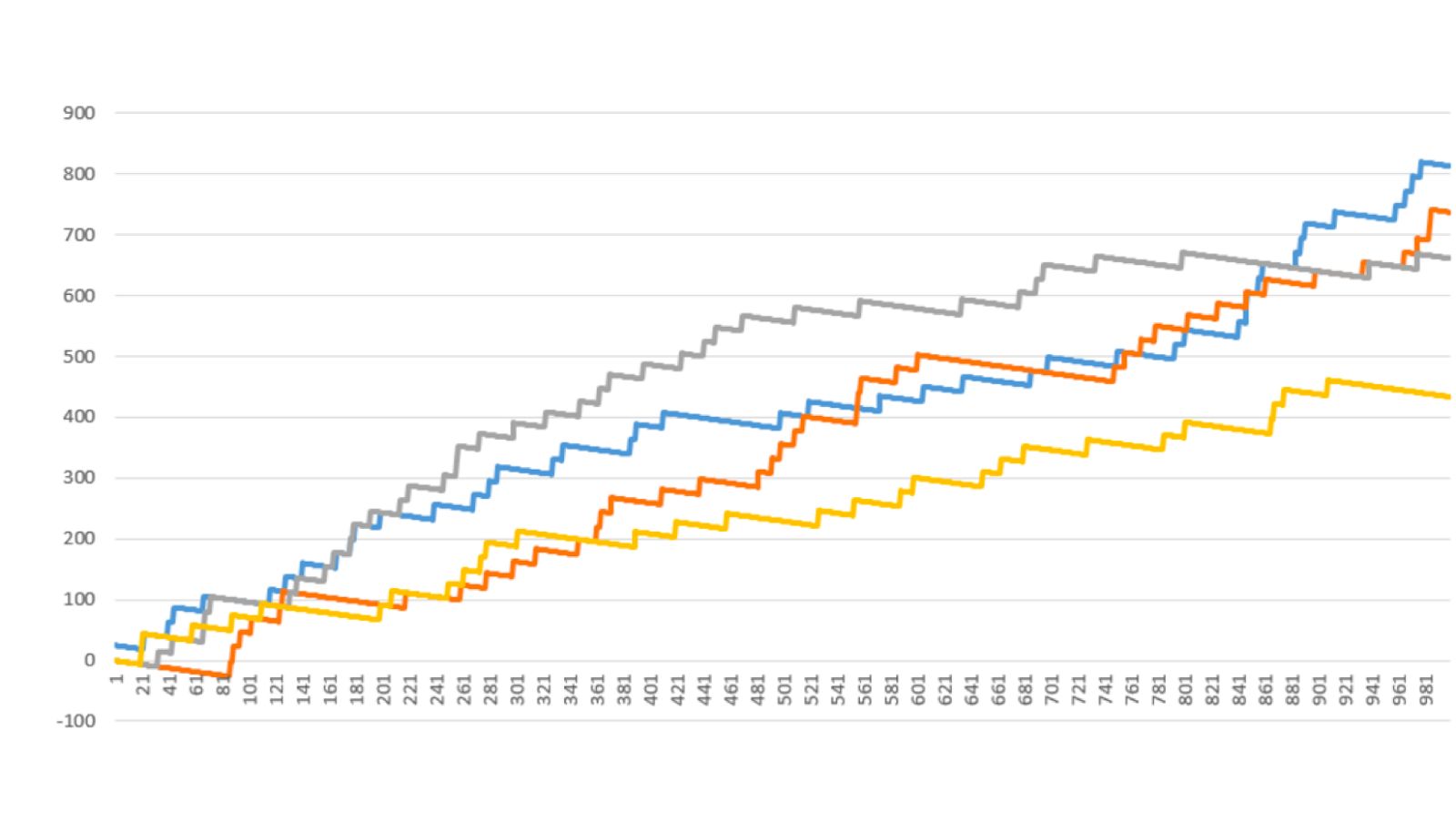

Давайте увеличим дистанцию. Итак, еще четыре эксперимента, на этот раз по 1000 испытаний в каждом:

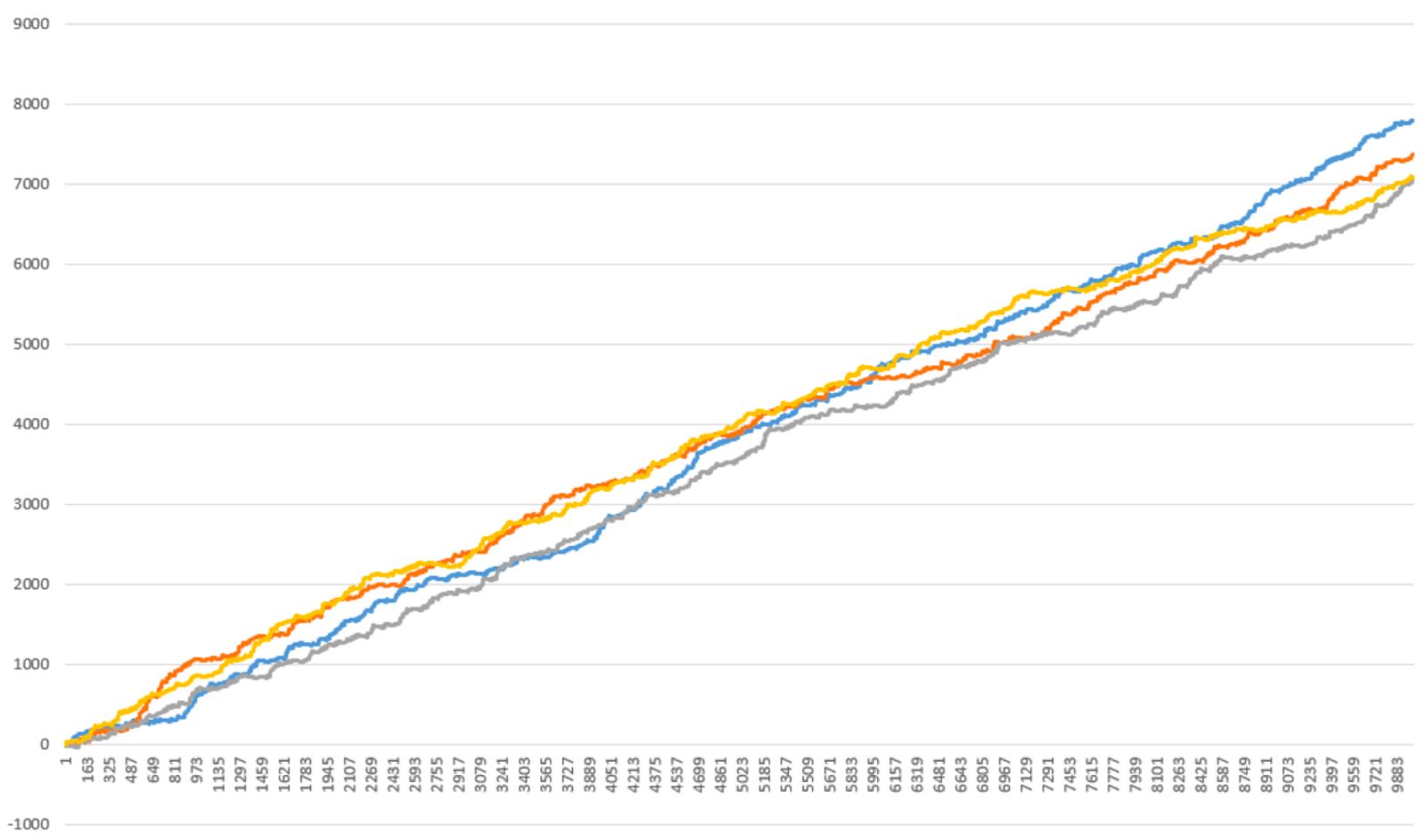

Вроде бы, все уже не так плохо. Лучший и худший результаты различаются всего в два раза. Пойдем до предела и проведем 10.000 испытаний:

Ну наконец-то. За четыре эксперимента мы получили разброс всего в 10%. 10.000 испытаний. Один и тот же случайный процесс. И разброс 10%.

По секрету скажу, что для идеального совпадения результатов нужно примерно 100.000 испытаний.

И что с того?

Когда вы оцениваете результат некоторого процесса с низкой вероятностью успеха, например, изменения дизайна на сайте с конверсией 3%, необходимо использовать достаточно БОЛЬШУЮ выборку испытаний, чтобы доверять итоговому результату. Как видно из примеров выше, выборка должна быть в районе 100.000 испытаний.

Если вы пытаетесь понять, как текст или картинка на лендинге влияют на продажи, необходимо провести достаточное количество испытаний.

Оценивать эффективность изменений на выборке в 1000 посетителей – значит изучать белый шум.

Важно, что это правило работает также и вне интернета. Если вы раздаете в городе флаеры или клеите афиши, их надо раздавать и клеить очень много. Подозреваю, что конверсия у флаера в продажи будет куда меньше 3%, а потому количество в 10 - 30 тысяч штук – минимальный порог, при котором можно оценить эффективность канала. Все остальное - случайность. Дисперсия.

Фото: Snob.ru

Чем выше вероятность наступления нужного вам результата, тем меньшая выборка нужна, чтобы оценить результат. Например, если вы тестируете на сайте кнопки двух цветов, и одна дает конверсию на 40% больше, выборки в 10.000 испытаний будет, думаю, достаточно.

Теперь вспомните все тысячи исследований и примеров, которые вы видели в интернете, где данное правило не выполняется. И смело отправляйте их в мусорную корзину. Глядишь, освободится место для чего-то реально полезного.

Артем Крамин, основатель сети "Выйти из комнаты".

Фото на обложке: предприниматели, недооценившие силу дисперсии, жгут аналитику на улицах Асунсьона, Парагвай. (С) www.thequint.com