9 SEO-ошибок, которые способны убить сайт

Оптимизация сайта – довольно сложный и трудозатратный процесс. Если вам кажется, что у вас все идеально, то еще раз проверьте по пунктам свой ресурс. Ведь на ранжирование сайта в поисковой выдачи влияет множество факторов, даже от незначительных деталей зависит результат продвижения. Итак, давайте по порядку:

1. Фильтры и санкции поисковых систем

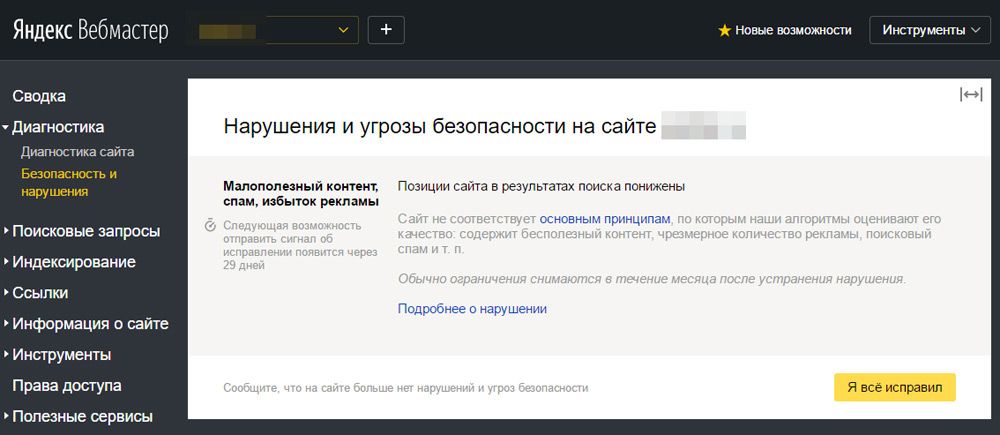

Этот пункт проверяется в Яндекс.Вебмастере: зайдите в раздел Диагностика, а потом в Безопасность и нарушения. В Google такую проверку можно осуществить в разделе Поисковый трафик, а затем перейти в Меры, принятые вручную.

Как правило, некоторые даже не догадываются, что их сайт находится под фильтрами. Например, недавно к нам пришел пользователь с вопросом, почему сайт просел в выдаче. Мы посмотрели наличие фильтров и обнаружили такую картину:

2. Контент

Шаблонные фразы уже давно всем надоели. Как можно принять решение о покупке, если везде одинаковые тексты? Поэтому обратите внимание на качество контента. Он должен быть уникальным, также не забываете про УТП.

Если у вас копипаст, это грозит санкциями и понижению сайта в выдаче. Проверить свой сайт можно через сервисы text.ru или content-watch.ru.

О том, как правильно писать тексты, как выделиться среди конкурентов и многом другом, читайте в нашей подборке статей.

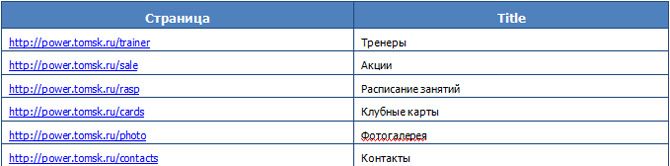

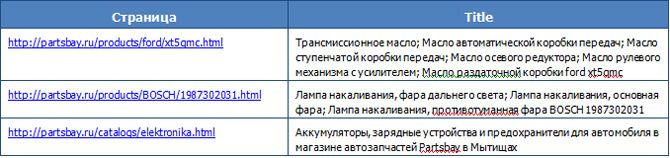

3. Теги title и description, H1-H3

Правильно подобранные ключевые слова – это основа SEO-продвижения. К тому же это один из факторов влияющих на релевантность страницы.

Неоднократно встречали, что title и description неправильно заполнены. Две наиболее распространенные ошибки – либо полное отсутствие ключевых слов, либо переспам с ключами в заголовке.

Так делать не нужно, найдите золотую середину. И не забывайте, что теги должны быть предназначены не только для поисковых роботов, но и для людей. Как правильно прописать теги, можно посмотреть в этой статье.

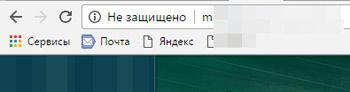

4. Протокол сайта HTTPS

В начале 2017 года Google начал помечать все сайты, которые содержат формы, передающие персональные данные, как небезопасные. Этот пункт тоже влияет на ранжирование сайта в поисковой выдаче.

Если еще не переехали на https, то рекомендуем исправить это как можно быстрее. Еще один важный момент – правильный алгоритм действий.

Самая распространенная ошибка заключается в том, что многие просто настраивают 301-редирект со старой версии http на https после покупки SSL-сертификата. Но забывают о файле robots.txt, директиве Host, настройке вебмастеров. Поэтому ресурс, который находится на http, выпадает из индекса. А новый сайт на https еще не проиндексирован, поэтому все позиции улетают в трубу. Подробная инструкция по переезду на протокол https есть тут.

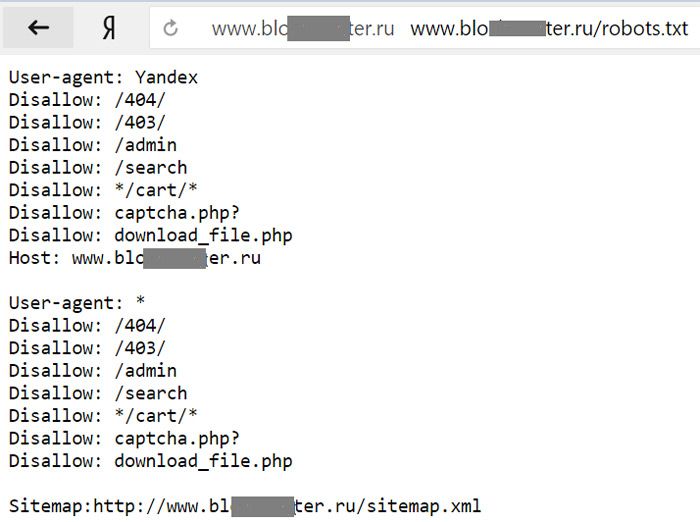

5. Robots.txt

Этот файл предназначен для поисковых роботов, в нем нужно указать параметры индексации сайта для ботов.

Есть случаи, когда владельцы сайтов вовсе забывают про robots.txt. Например, недавно пришел в работу сайт, который не имел robots.txt, но был полностью открыт для индексации. Все настроили, сейчас все в порядке:

Или второй вариант, когда сайт полностью закрыт от индексации. За это отвечают директивы Disallow и Allow, которые запрещают или разрешают индексирование разделов, отдельных страниц сайта или файлов. Для проверки файла у поисковых систем есть специальные инструменты: Яндекс и Google.

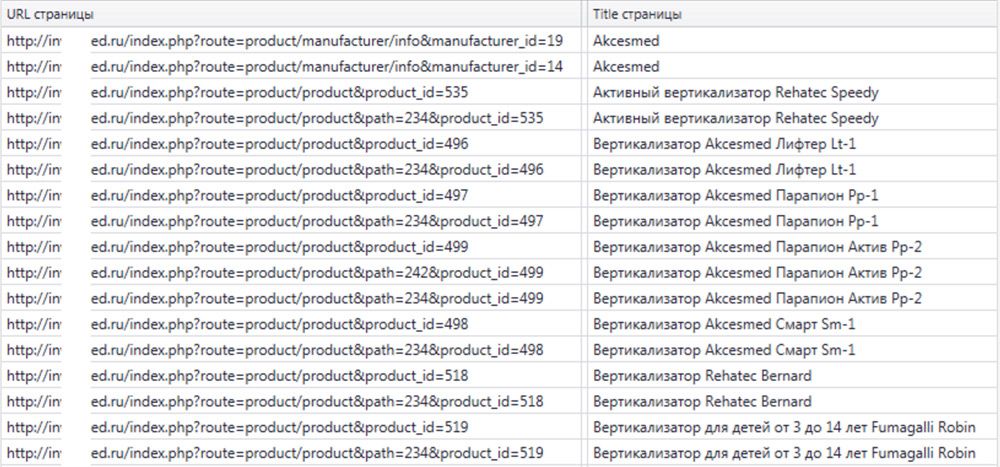

6. Дубли страниц

Страницы могут как полностью, так и частично совпадать друг с другом, но при этом у них будут разные URL.

Поисковые роботы негативно относятся к дублям страниц, если обнаружили у себя такие, то рекомендуем их убрать. В 90% случаев дубли мешают продвижению.

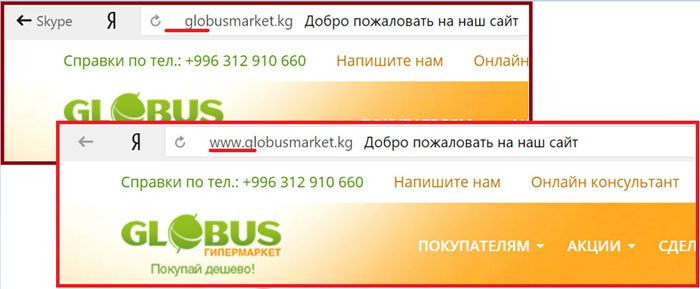

7. Зеркала сайта

Зеркало сайта – это полная копия ресурса, доступная по разным адресам. Все зеркала важно склеить через 301 редирект.

Если зеркало не склеено, то показатели тИЦ, вес внешних ссылок будут растекаться, так как для поисковиков это разные ресурсы. Все это мешает росту сайта в выдаче.

Сайт не должен открываться по разным адресам, с www и без www, просто site.ru и site.ru/index.php, по http и https и т. д.:

Вот небольшой чек-лист для проверки:

- Сайт должен быть доступен только по одному протоколу http или https.

- Выбрано главное зеркало сайта, с www или без www, указано в Вебмастере.

- Настроен 301 редирект со всех зеркал.

- Главная страница сайта доступна по одному адресу без /index.php, /index.html и т.п.

8. Адаптивная верстка

Пользователи все чаще используют мобильные устройства для поиска в Интернете, к тому же доля мобильного трафика превышает компьютерный. Также стоит отметить, что год назад Яндекс запустил алгоритм Владивосток. Если сайт не адаптирован под мобильные устройства, то он будет ранжироваться хуже.

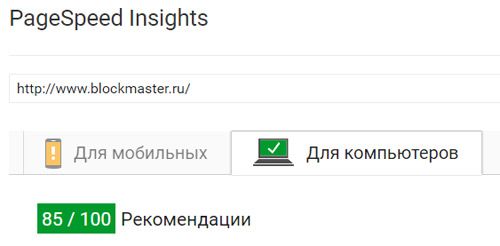

9. Скорость загрузки сайта

Тут все просто. Пользователям не нравятся медленные сайты. Поисковые системы также отдают предпочтение быстрым, оптимизированным сайтам. Проверить скорость загрузки своего сайта можно с помощью инструмента Google. Красный – медленно, важно срочно увеличивать скорость, желтый – нормально, но нужно оптимизировать, зеленый – отлично.

Это основные пункты, на которые стоит обратить внимание. Если у вас все отлично по ним, то можете не переживать за свой сайт. Если же наоборот увидели недочеты, срочно их исправляйте.